Documentation Index

Fetch the complete documentation index at: https://docs.crewai.com/llms.txt

Use this file to discover all available pages before exploring further.

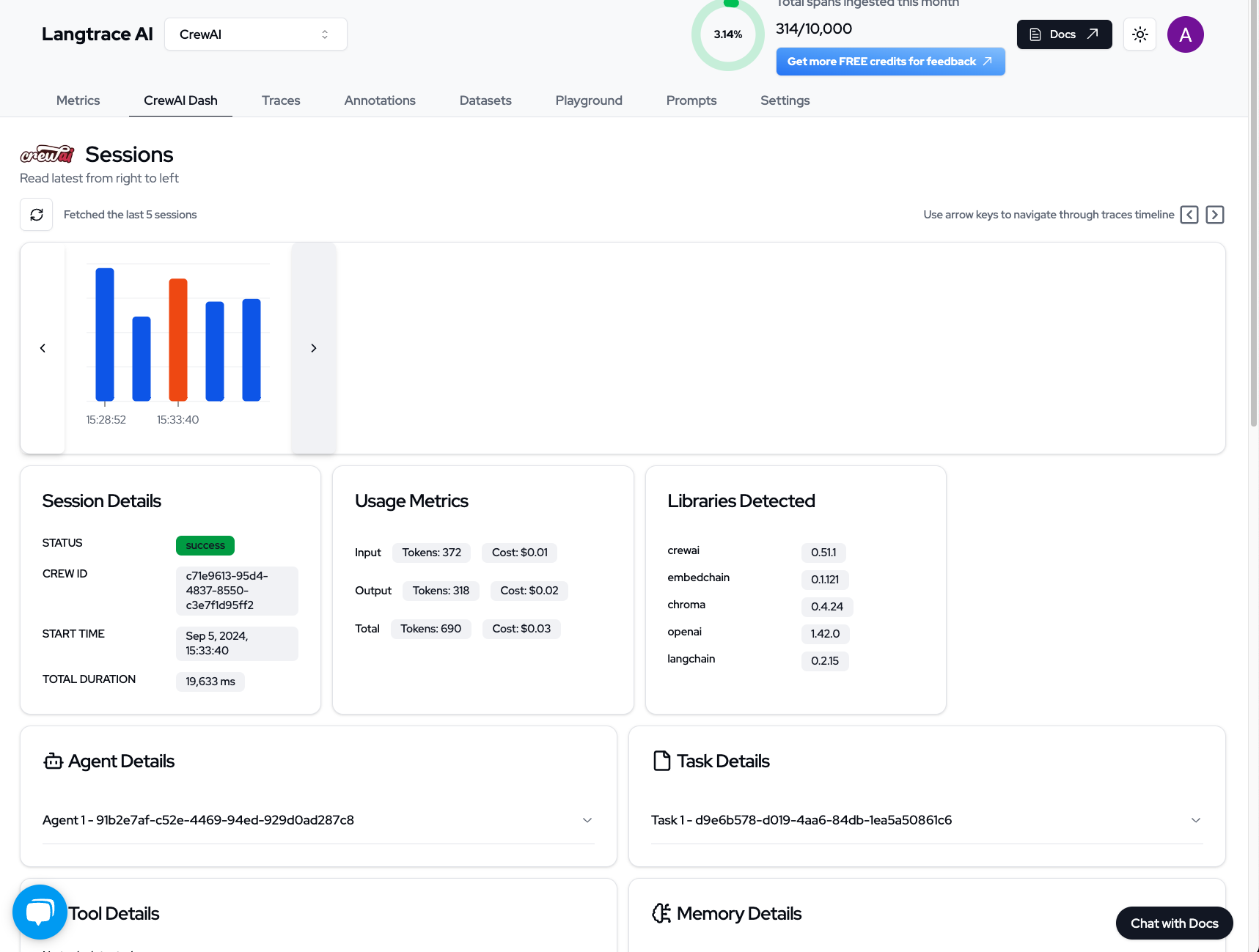

نظرة عامة على Langtrace

Langtrace هو أداة مفتوحة المصدر خارجية تساعدك في إعداد المراقبة والتقييمات لنماذج اللغة الكبيرة (LLMs) وأطر عمل LLM وقواعد بيانات المتجهات. على الرغم من أنها ليست مبنية مباشرة في CrewAI، يمكن استخدام Langtrace جنباً إلى جنب مع CrewAI للحصول على رؤية عميقة في التكلفة وزمن الاستجابة وأداء وكلاء CrewAI. يتيح لك هذا التكامل تسجيل المعاملات الفائقة ومراقبة تراجعات الأداء وإنشاء عملية للتحسين المستمر لوكلائك.

تعليمات الإعداد

التسجيل في Langtrace

سجّل بزيارة https://langtrace.ai/signup.

الميزات وتطبيقاتها على CrewAI

-

تتبع رموز LLM والتكاليف

- مراقبة استخدام الرموز والتكاليف المرتبطة لكل تفاعل وكيل CrewAI.

-

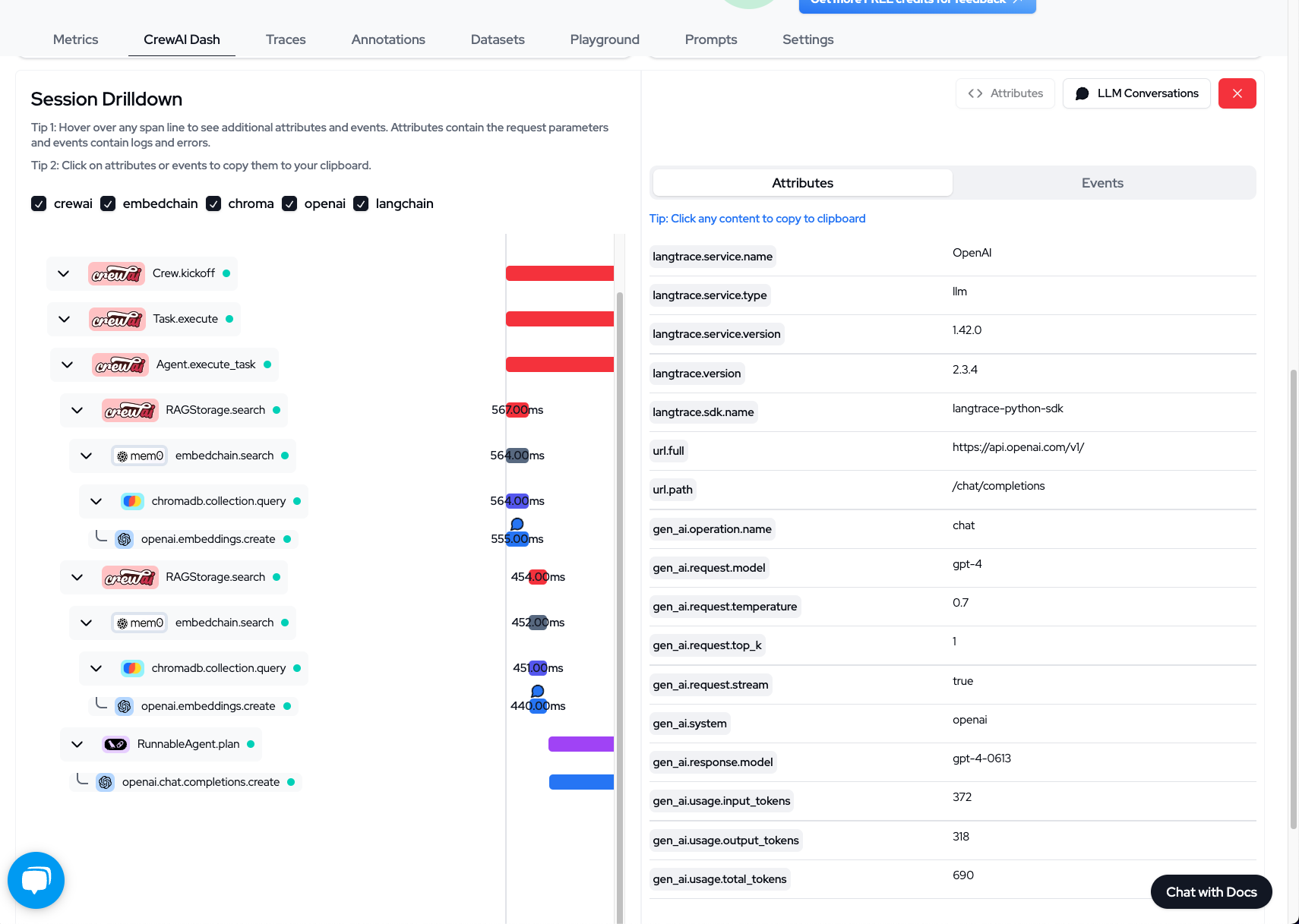

رسم بياني للتتبع لخطوات التنفيذ

- تصور تدفق تنفيذ مهام CrewAI، بما في ذلك زمن الاستجابة والسجلات.

- مفيد لتحديد الاختناقات في سير عمل الوكلاء.

-

تنظيم مجموعات البيانات مع التعليق اليدوي

- إنشاء مجموعات بيانات من مخرجات مهام CrewAI للتدريب أو التقييم المستقبلي.

-

إدارة إصدارات المطالبات

- تتبع الإصدارات المختلفة من المطالبات المستخدمة في وكلاء CrewAI.

- مفيد لاختبار A/B وتحسين أداء الوكلاء.

-

ساحة المطالبات مع مقارنات النماذج

- اختبار ومقارنة مطالبات ونماذج مختلفة لوكلاء CrewAI قبل النشر.

-

الاختبارات والتقييمات

- إعداد اختبارات آلية لوكلاء ومهام CrewAI.